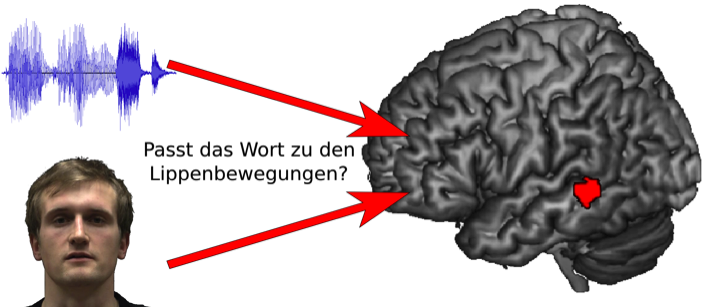

Bauletter, BAULINKS.de-Meldungen, vom 14.11.2012Lippenlesen hilft, wenn’s laut istIn einer lauten Umgebung kann Lippenlesen helfen, die Worte eines Gesprächspartners besser zu verstehen. Forscher am Leipziger Max-Planck-Institut (MPI) für Kognitions- und Neurowissenschaften haben nun die neuronalen Grundlagen dieses Phänomens näher untersucht. Sie konnten zeigen, dass Wörter und Lippenbewegungen einander umso besser zugeordnet werden, je größer die Aktivität in einer bestimmten Region im Schläfenlappen des Gehirns ist. Im sogenannten oberen temporalen Sulcus werden visuelle und auditive Informationen miteinander verknüpft.

Im Alltag versuchen wir selten bewusst, anderen die Worte von den Lippen abzulesen. Doch in einer lauten Umgebung ist es oft sehr hilfreich, dem Gesprächspartner auf den Mund zu schauen. Warum das so ist, erklärt Helen Blank, Wissenschaftlerin am Leipziger MPI so: „Indem unser Gehirn beim Lippenlesen Informationen aus verschiedenen sensorischen Quellen verbindet, verbessert sich das Sprachverstehen“. In einer aktuellen Studie hat die Mitarbeiterin der Max-Planck-Forschungsgruppe "Neuronale Mechanismen zwischenmenschlicher Kommunikation" näher untersucht, auf welche Weise visuelle und auditorische Areale des Gehirns beim Lippenlesen zusammenarbeiten. Im Experiment hörten Probanden zunächst kurze Sätze, dabei wurde ihre Hirnaktivität mithilfe funktioneller Magnetresonanztomografie gemessen. Darauf folgte jeweils ein kurzes tonloses Video von einer sprechenden Person. Per Knopfdruck gaben die Teilnehmer danach an, ob Wörter und Mundbewegung ihrer Meinung nach zusammen gepasst hatten. War dies nicht der Fall, reagierte ein Teil des Netzwerks von Hirnarealen, das visuelle und auditorische Informationen verknüpft, mit erhöhter Aktivität und erhöhte seine Verbindung zu auditorischen Sprachregionen. „Wahrscheinlich entsteht durch die akustische Vorinformation eine Erwartungshaltung darüber, welche Lippenbewegungen man sehen wird“, vermutet Blank. „Ein Widerspruch zwischen Vorhersage und dem tatsächlich Wahrgenommenen wird im STS (Sulcus Temporalis Superior) als Fehler registriert.“ Wie stark die Aktivität in diesem Areal ausfiel, hing direkt mit den Lippenlese-Fähigkeiten zusammen: Je stärker sie war, desto häufiger lagen die Teilnehmer im Experiment richtig. „Bei den besten Lippenlesern wurde also ein besonders starkes Fehlersignal generiert“, erklärt Blank. Dieser Effekt ist offenbar spezifisch für Sprache: Er trat nicht auf, wenn Probanden entscheiden sollte, ob die Identität der Stimme und des Gesichtes zusammen passten. Die Studie ist ein wichtiges Ergebnis nicht nur für die Grundlagenforschung auf diesem Gebiet. Besseres Wissen darüber, wie das Hirn Gehörtes und Gesehenes bei der Sprachverarbeitung miteinander verbindet, könnte auch in den klinischen Wissenschaften Anwendung finden. „Menschen mit Hörstörungen sind oft sehr stark auf das Lippenlesen angewiesen“, sagt Blank. Weiterführende Studien könnten etwa untersuchen, was im Gehirn passiert, wenn Lippenlesen bewusst trainiert oder mit Gebärdensprache kombiniert wird, so die Forscherin. Übrigens: 2011 hatte ein Team um Helen Blank in einer Studie gezeigt, dass im Gehirn eine direkte anatomische Verbindung zwischen Stimm- und Gesichtserkennung besteht. http://dx.doi.org/10.1016/j.neuroimage.2012.09.047 ... Bevor Sie die neuen Erkenntnisse am Wochenende in der Disco ausprobieren können, geht es hier ganz ohne Stimme sondern nur mit Buchstaben und Bildern weiter:

Zertifizierung Bau stellt Rechtsgutachten zur Vergabe im Kanalbau vor

DBV-Heft 19 „Schutz und Instandsetzung von Betonbauteilen“ aktualisiert und

erweitert

Deutscher Landschaftsarchitektur-Preis 2013 vom bdla ausgelobt

FLL-Fachtagung zum Fassadensockel am 12.12. in Frankfurt/Main

PDR

und bvse fordern stoffliches Recycling auch für Sonderabfälle

Matthias Irmscher als Präsident der Vereinigung Freischaffender Architekten

bestätigt

600

Gäste beim Deutschen Baugewerbetag 2012

KME

stellt sich neu auf

Verbraucherschutzorganisationen reagieren auf IBG-Insolvenz

|